网络直播行业如何构建“清朗”生态?

《网络直播App未成年人保护报告》昨日发布。 南都记者 朱芳圆 摄

中国未成年人的互联网普及率已达93.1%,网络直播成为未成年人的一种重要娱乐形式。然而,网络直播的崛起和发展也一路伴随争议,一些中小型平台更是乱象频出。“8岁男童两小时打赏主播9.3万”“00后女孩打赏主播65万”“14岁全网最小二胎妈妈成网红主播”……从2017年开始,类似案例便不时曝光。

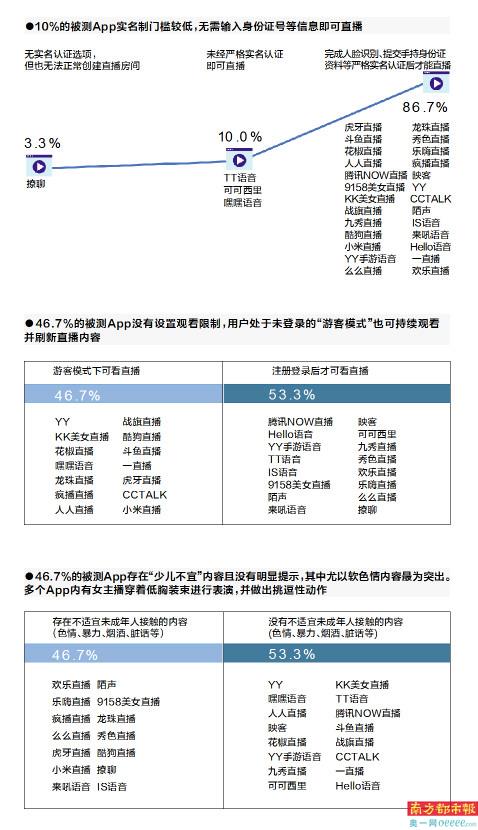

日前,国家网信办、全国“扫黄打非”办等部门针对网络直播行业及未成年人暑期网络环境启动了专项整治。在此背景下,南都个人信息保护研究中心测评30款网络直播App,并于昨日发布《网络直播App未成年人保护报告》(以下简称“报告”)。报告显示,绝大多数被测App无法有效识别未成年人并征得家长同意;46.7%的被测App存在不适宜未成年人接触的内容且没有明显提示,其中尤以软色情内容最为突出,多个App内有女主播穿着低胸装束进行表演,并做出挑逗性动作。

被测App普遍无法有效识别未成年人身份

近日,南都个人信息保护中心(以下简称“中心”)结合多个安卓应用商店内视频、语音类直播App的下载排名情况,选取了30款直播App作为测评对象。

测评满分为100分,主要从隐私政策合规、账号创建及家长同意、内容建设及审核、特殊技术设计(如青少年模式)、充值打赏设置等五个方面展开,考察被测App是否采取了有效措施保障未成年用户的网络权益。测评取证时间为2020年7月3日至7月8日(各款App在取证时间之外的变更不计入此次测评)。

测评结果显示,30款App对未成年人的保护程度均处于中等或低下水平。无法有效甄别用户年龄、无法识别出未成年人并征得其监护人同意,是App的集中失分点。

根据《信息安全技术 个人信息安全规范》,个人信息控制者收集年满14岁的未成年人个人信息前,应征得未成年人或其监护人的明示同意;不满14周岁的,应征得其监护人的明示同意。

然而,由于绝大多数App支持手机号或第三方账号登录,未成年人可以轻松完成账号创建。一些App要求用户在注册时填写年龄,但当用户填写的年龄低于18周岁时,App会自动将年龄调整为18周岁及以上,或是禁止用户注册,以规避“平台上有未成年人用户”的情况。

还有App设置了“一刀切”式的隐私政策,将责任推给用户。例如,KK直播在隐私政策中声明“除非所在地法律允许并且监护人同意,未成年人请不要注册账户或者发送自己的姓名、住址、电话、邮件地址等个人信息给我们。”

身份识别难题在于实名认证手段的强弱

“如果不能识别未成年用户,那么所有针对未成年人的管理和保护措施都无法实行。”在研讨会上,中国政法大学副教授、全国人大两法修改专家顾问苑宁宁说。他认为,最有效的方式可能还是生物识别,比如人脸识别,现在已经有网络游戏平台在探索使用这种方式。但相应的,生物识别也会加重企业维护用户信息安全的负担,还有很多民众对生物识别存在疑虑。这就涉及价值选择和平衡的问题。

中国社会科学院大学互联网法治研究中心执行主任刘晓春表示,目前针对未成年人身份识别的难题,主要不是有无实名认证的问题,而是实名认证手段强弱的问题。

“我国的实名认证制度,也分为多种形式,有的是较弱的实名制,如通过手机号认证,通过身份证号认证,有些是较强的实名制,如需要提交身份证正反面照片,甚至手持身份证照,而最强程度的实名认证,是涉及金融支付等领域,需要通过银行卡验证来注册账户,支付时则通过密码、验证码、人脸识别等方式确认是本人行为。”刘晓春说,强实名认证方式会不可避免地收集和使用更多的未成年人个人信息,从而造成风险防范和隐私保护的悖论。

她分享了一种解决思路:在需要强实名认证时,企业可以跳转对接具备相应认证能力的服务或者政府数据库,比如跳转至政府统一加密的数据库,或者调用支付宝、微信等数据接口进行人脸识别,从而在一定程度上降低自身的隐私泄露风险。

超四成被测App含软色情等“少儿不宜”内容